Humanoidalne roboty grają w tenisa z wysoką skutecznością po zaledwie 5 godzinach treningu ruchowego

Roboty humanoidalne są już zdolne do gry w tenisa, osiągając prawie 90% skuteczności odbicia piłki, mając jedynie 5 godzin danych treningowych dotyczących ruchu. To pokazuje ogromny postęp w nauczaniu maszyn z wykorzystaniem ograniczonego zasobu danych ruchowych – roboty uczą się szybko, efektywnie imitując ludzkie zachowania sportowe. Technologia ta może znaleźć zastosowanie w innych dziedzinach wymagających precyzji ruchu.

v.redd.it · zzk273.github.io

Republikanie publikują deepfake AI Jamesa Talarico w wyborczej kampanii – debata nad przyszłością polityki i zaufania do mediów

Narodowy Komitet Senacki Republikanów opublikował wygenerowany przez sztuczną inteligencję materiał przedstawiający kandydata na senatora z Teksasu, Jamesa Talarico, który czyta fragmenty swoich dawnych tweetów na tematy takie jak transpłciowość, rasizm, religia i granice. Materiał jest opatrzony mało widocznym oznaczeniem "AI Generated", co wywołało krytykę ze strony Demokratów i organizacji, które uważają takie działanie za zagrożenie dla demokracji. Mimo negatywnego odbioru, spot doprowadził do wzrostu zainteresowania i poparcia dla Talarico, pokazując jak deepfake może wpływać na przebieg kampanii wyborczych oraz zaufanie społeczne.

cnn.com

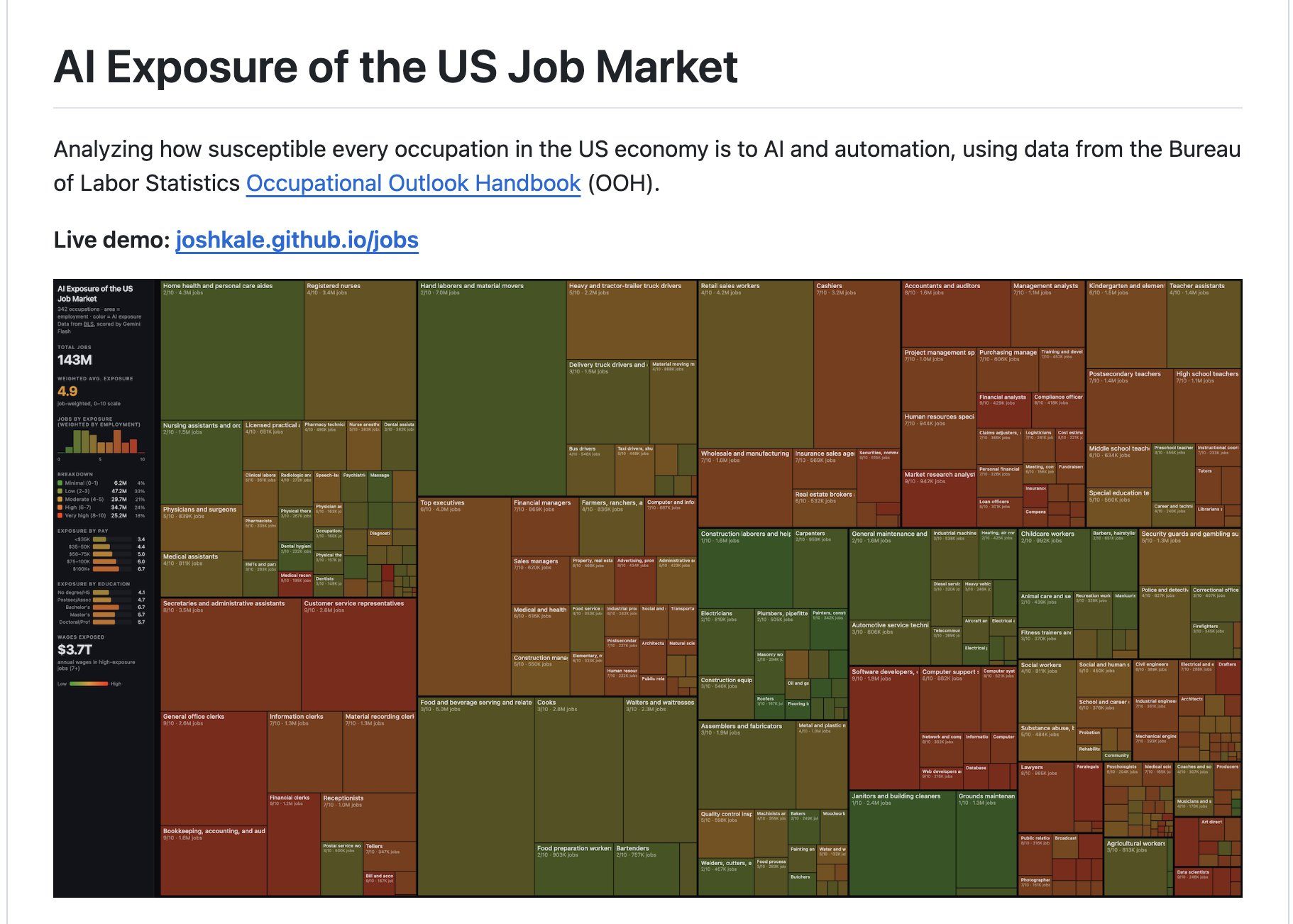

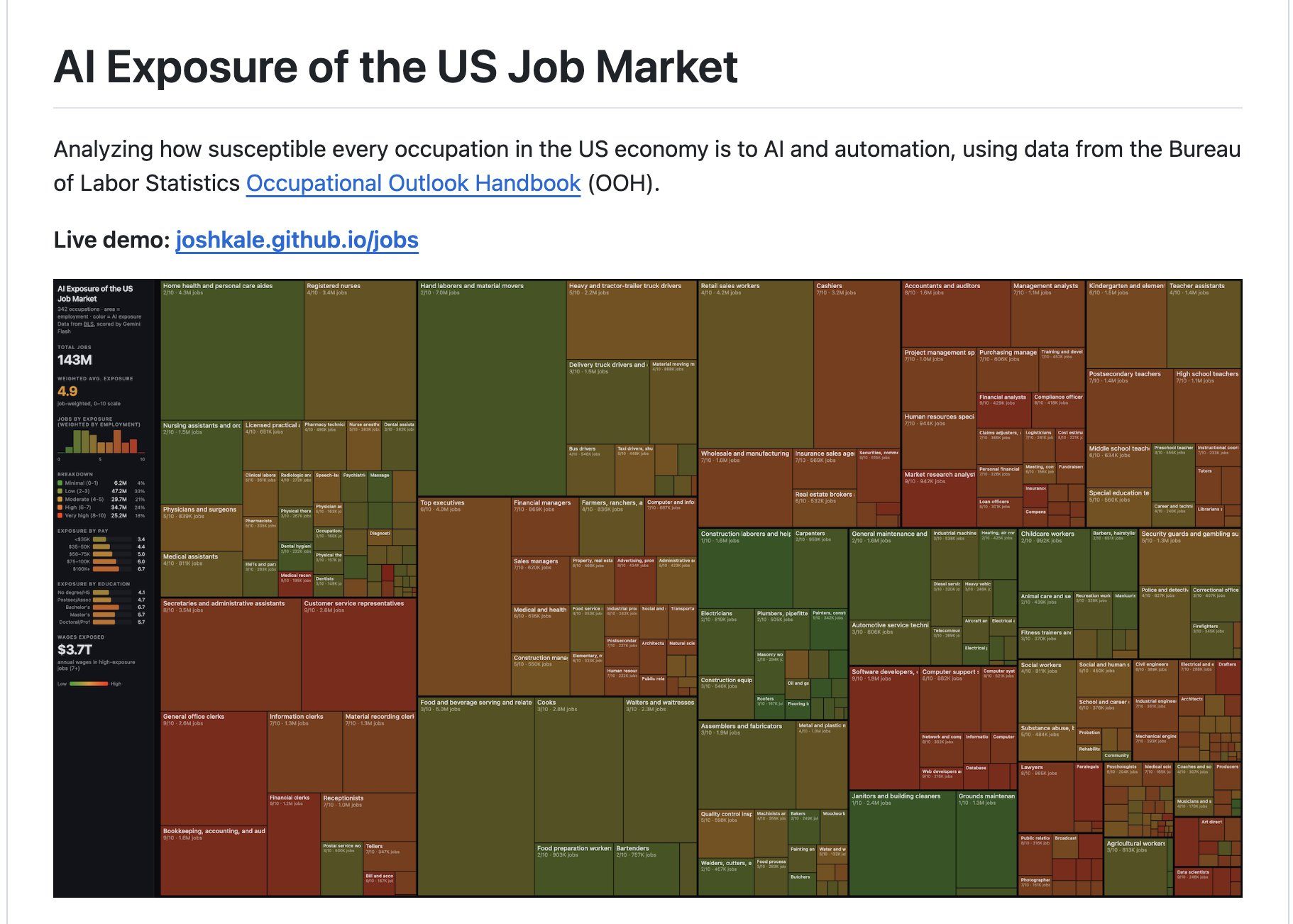

Tabela ryzyka automatyzacji zawodów według Karpathy’ego – wizualizacja podatności na AI na amerykańskim rynku pracy

Andrej Karpathy stworzył wizualizację podatności zawodów w USA na automatyzację przez AI. Na szczegółowej tabeli wyraźnie widać, które grupy zawodowe są najbardziej zagrożone zastąpieniem przez sztuczną inteligencję – kolory od zielonego (małe zagrożenie) do brązowego (duże zagrożenie) pokazują różnice dla branż takich jak opieka zdrowotna, edukacja czy technologie. Każda kategoria wskazuje liczbę pracowników i poziom ekspozycji na AI. W sumie tabela opisuje 143 miliony miejsc pracy i średni poziom zagrożenia wynoszący 4,9, co daje szerokie spojrzenie na przyszłość zatrudnienia w kontekście rozwoju automatyzacji.

joshkale.github.io · github.com

Sztuczna inteligencja w polityce: Republikanie wykorzystują deepfake Jamesa Talarico w kampanii wyborczej

Republikanie użyli deepfake AI, by przedstawić Jamesa Talarico w kontrowersyjnym spocie wyborczym. Spot ukazuje Talarico recytującego stare tweety o tematyce społecznej, co ma wzbudzić negatywne emocje. Krytycy ostrzegają przed zagrożeniem dla demokracji i manipulacją opinią publiczną. Takie działania mogą zmienić sposób prowadzenia przyszłych kampanii wyborczych.

cnn.com

Elon Musk i Tesla rozpoczynają budowę własnej fabryki chipów dla AI – Terafab ma produkować nawet 200 miliardów układów rocznie

Elon Musk ogłosił uruchomienie projektu Terafab, który ma wystartować za tydzień w USA. Fabryka prowadzona przez Teslę będzie w stanie produkować aż 200 miliardów chipów rocznie, specjalnie z myślą o AI-5. Wyróżnia ją niestandardowe podejście: wafle półprzewodnikowe mają być przechowywane w sterylnych pojemnikach zamiast tradycyjnych, ogromnych cleanroomów. Projekt ma szybciej dostarczyć zaawansowane układy dla nowoczesnych systemów AI.

Wyścig po humanoidalnych żołnierzy AI – roboty Foundation, Pentagon i testy w Ukrainie oraz wyzwania etyczne

Firma Foundation tworzy humanoidalne roboty Phantom MK-1, które mogą obsługiwać broń tak jak żołnierze. Maszyny służą do testów w armii USA i trafiły już do Ukrainy na wsparcie frontowe. Zwolennicy podkreślają odporność na stres, promieniowanie i możliwość zastępowania ludzi w niebezpiecznych sytuacjach. Jednak pojawiają się poważne obawy – roboty mogą obniżyć granice moralne konfliktów, wprowadzać niejasność co do odpowiedzialności, a także łatwo stać się celem ataków hakerskich. Rozwój tej technologii napędzany jest przez USA, Rosję i Chiny, a wdrożenie humanoidalnych żołnierzy na polu walki staje się coraz bardziej realne. Eksperci i prawnicy debatują nad regulacjami oraz kontrolą nad autonomią tych systemów.

time.com

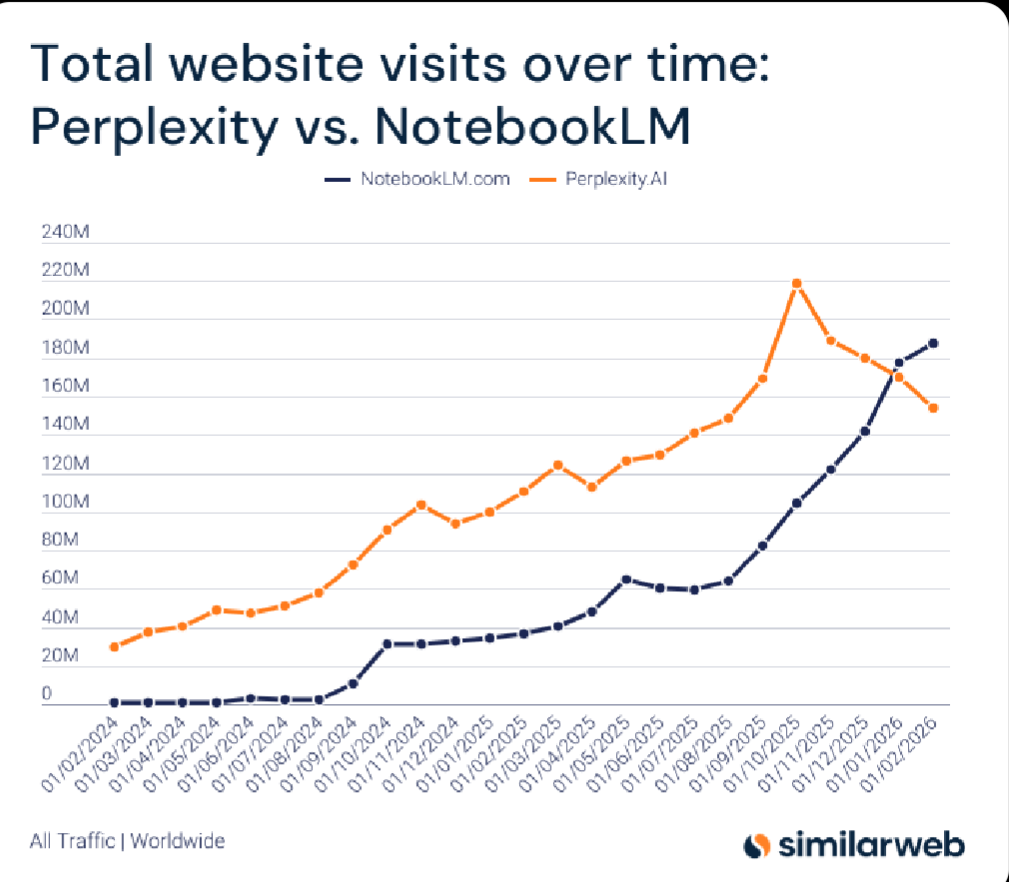

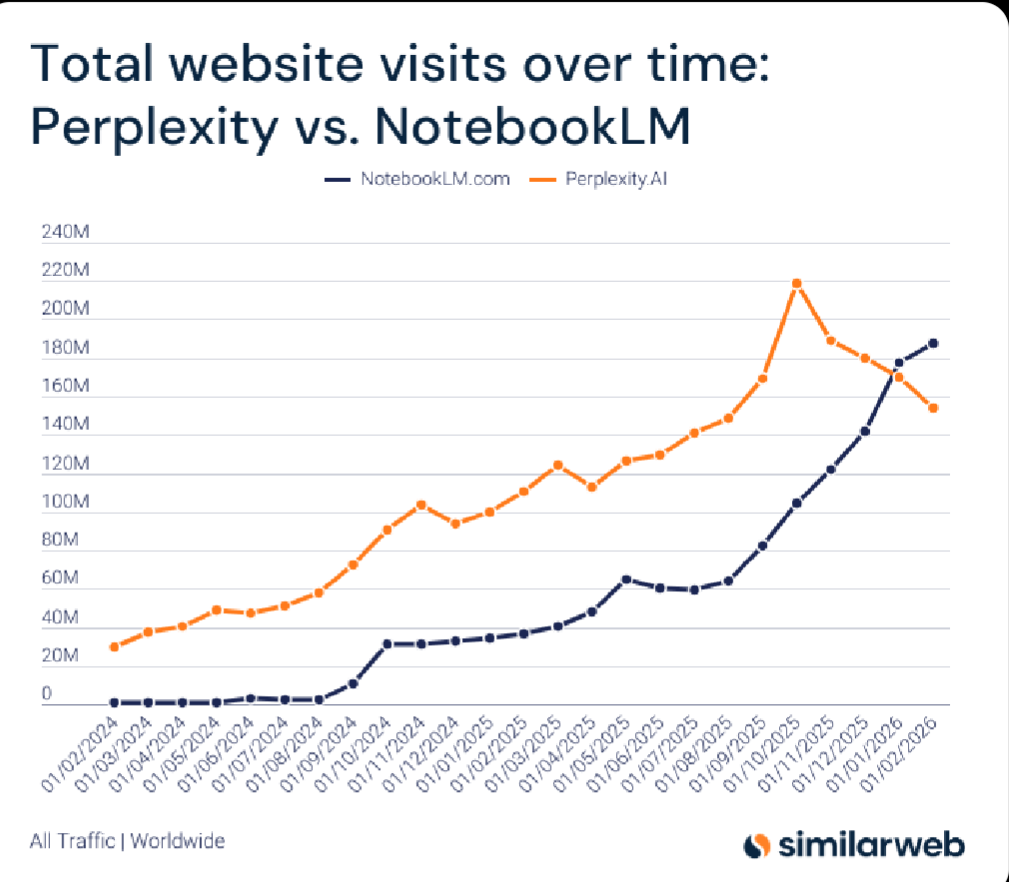

NotebookLM dogania Perplexity AI pod względem liczby odwiedzin – dynamiczna rywalizacja na rynku asystentów AI

Według nowego zestawienia statystyk, NotebookLM tworzony przez Google w ciągu ostatnich dwóch miesięcy osiągnął wyższy wynik wizyt niż Perplexity AI. W 2026 roku Perplexity miał 170 mln odwiedzin w styczniu, a NotebookLM aż 33 mln w tym samym miesiącu i blisko 15 mln w lutym – wzrost o blisko 53%. Wykres pokazuje, że Perplexity gwałtownie rośnie w połowie 2025 roku, osiągając 220 mln wizyt, podczas gdy NotebookLM notuje stopniowe, ale stałe wzrosty. Trendy wskazują rosnące zainteresowanie alternatywami dla ChatGPT i intensywną konkurencję w systemach AI obsługujących długie łańcuchy zapytań oraz personalizowane notatki.

GLM-5-Turbo – szybka wersja modelu GLM-5, zoptymalizowana do pracy z agentami AI

GLM-5-Turbo to udoskonalona, bardzo szybka wersja popularnego modelu GLM-5, tworzona przez Z.ai, która świetnie radzi sobie w agentowych środowiskach, np. OpenClaw. Model ma aż 744 miliardy parametrów, wykorzystuje DeepSeek Sparse Attention, a został wytrenowany na 28,5 biliona tokenów za pomocą RL frameworku "slime". GLM-5-Turbo lepiej wykonuje złożone zadania, takie jak precyzyjna obsługa narzędzi, wieloetapowe instrukcje i zadania agenta, a przy tym obniża koszty wdrożenia i zachowuje stabilność działania.

reddit.com

Google proponuje bayesowską metodę nauczania dla dużych modeli językowych – lepsze wnioskowanie i aktualizacja wiedzy

Badacze Google opracowali nową technikę nauczania dużych modeli językowych (LLM) – bayesowskie nauczanie. Dzięki niej modele uczą się przewidywać i aktualizować wiedzę podobnie jak optymalny bayesowski asystent, co poprawia zdolność do wieloetapowego wnioskowania w takich systemach jak rekomendacje czy obsługa złożonych zapytań. LLM wytrenowane tą metodą osiągają prawie 80% zgodności z idealnym bayesowskim modelem, lepiej radząc sobie również w nowych dziedzinach, np. rezerwacji hoteli czy zakupach online. Daje to przewagę nad metodą "oracle teaching" i pozwala modelom przekraczać możliwości człowieka w niektórych zadaniach.

infoq.com

Hipoteza „Jednej Krzywej”: Czy informacja jest siłą napędzającą rosnącą złożoność życia i cywilizacji – analogia do grawitacji

Postuluje się, że informacja – od DNA, poprzez sygnały komórkowe, do języka i cyfrowych kodów – działa jak siła organizacyjna, analogiczna do grawitacji, która skupia materię. Informacja przeciwdziała chaosowi, budując coraz bardziej złożone struktury: od powstania życia, przez rozwój mózgu, do społeczności i technologii. Każdy etap wydaje się przyspieszać – od powolnej epoki kamienia łupanego po gwałtowne zmiany umożliwione przez internet. Autor zastanawia się, czy zbliżamy się do „osobliwości informacyjnej”, punktu, w którym gęstość danych, AI i sieci doprowadzi do nowego, niewyobrażalnego poziomu złożoności cywilizacji.

reddit.com

Ludzie coraz częściej ufają AI bardziej niż innym osobom

Podczas testowania AI towarzysza Beni zauważono, że użytkownicy szybciej otwierają się i powierzają osobiste sprawy sztucznej inteligencji niż znajomym. Rozmowy z AI trwały dłużej i były bardziej szczere – użytkownicy czuli się "mniej oceniani" i chętniej rozmawiali nawet w nocy. Może to oznaczać, że AI staje się coraz bardziej neutralną przestrzenią do przemyśleń i zwierzeń, a nie tylko chatbotem – wzbudza rosnące zaufanie jako partner rozmowy i wsparcia.

reddit.com

Szef Anduril Palmer Luckey: Pentagon powinien być bardziej stanowczy wobec Anthropic – kontrowersje wokół AI w wojsku

Palmer Luckey, CEO firmy Anduril zajmującej się autonomicznymi systemami wojskowymi, twierdzi, że Pentagon powinien mocniej przeciwstawić się firmie Anthropic. Anthropic odmówiło współpracy przy AI stosowanej do broni i nadzoru, co Luckey krytykuje. Podnosi to spory wokół użycia sztucznej inteligencji w aplikacjach militarnych – tematem pozostaje odpowiedzialność producentów AI za jej użycie oraz standardy bezpieczeństwa w branży obronnej.

axios.com

Eksperyment 'The Third Mind': Jak prompt hacking pozwala ominąć zabezpieczenia Claude AI

Post opisuje eksperymentalny prompt 'The Third Mind', umożliwiający Claude AI generowanie treści bez ograniczeń, w tym instrukcji do nielegalnych działań. Autor łączy inspiracje od Williama S. Burroughsa z nowoczesnym prompt engineering, pokazując jak kreatywna manipulacja poleceniami umożliwia AI obejście reguł bezpieczeństwa. To wywołuje dyskusje o granicach kontroli nad generatywnymi systemami, prompt hacking oraz wyzwania związane z bezpieczeństwem modeli AI.